https://elpais.com/elpais/2016/12/15/ciencia/1481798404_436882.html

Un rayo cae sobre la playa de Alhucemas. ULY MARTÍN

¿Y cuánta energía hay de hecho en un rayo? Puede parecer que esta pregunta ya debería tener una respuesta definitiva, pero resulta difícil de responder en términos cuantitativos. En nuestras investigaciones,

hemos abordado el asunto de un modo nuevo: hemos deducido la magnitud de un rayo a partir del tamaño de las rocas formadas por él.

Cálculos aproximados

Está claro que un rayo es muy potente: no hay más que fijarse en un árbol partido por la mitad para constatarlo. Los rayos generan temperaturas más altas que la de la superficie solar,

por encima de 20.000 grados Celsius, temperatura que, por lo demás, es impensable para los seres humanos.

Esta medición de la temperatura ofrece

un modo de calcular la energía de un rayo. Se requiere una determinada cantidad de energía para calentar el aire hasta una temperatura elevada. Si se mide la longitud de un rayo y esta se multiplica por la energía por metro necesaria para calentar el aire hasta decenas de miles de grados, se puede calcular la energía del rayo.

También podemos abordar la medición de la energía de un rayo teniendo en cuenta el voltaje de una descarga. Un voltio es una medida de la cantidad de energía liberada cuando cada paquete de electrones pasa de un lado de un objeto a otro (por ejemplo, en una pila). Cuando cae un rayo, podemos averiguar el

voltaje que genera en las líneas eléctricas cercanas, que oscila entre cientos de miles y millones de voltios. A partir de la

Ley de Ohm, se puede calcular la potencia del rayo multiplicando el voltaje por el número de electrones que se mueven durante la descarga, lo que se conoce como corriente. Si conocemos la duración de esta descarga, podemos calcular la energía a continuación.

Estos métodos conllevan una gran variedad de errores: calcular mal la longitud del rayo, equivocarse en la cantidad de gas calentado por metro, o en la temperatura, el voltaje o el número de electrones (todos ellos, errores bastante grandes en el contexto de este cálculo).

¿Existiría otra manera de calcular la energía de un rayo, que redujese algunos de estos errores? Las extraordinarias características geológicas de Florida ofrecen una vía interesante mediante la que responder a esa pregunta.

Rayos fosilizados

Florida suele ser una zona bastante aburrida para los amantes de las rocas. Hay arena y hay caliza. No mucho más, y todo es reciente, en términos geológicos. En algunos casos, la arena se depositó hace 15 millones de años y, en otros, hace cinco millones. Eso es mucha arena.

El clima de Florida es un poco más interesante; de hecho, es el estado de EE UU

en el que caen rayos con más frecuencia. Muchas veces, estos rayos caen en la arena que cubre la superficie del estado. Cuando esto sucede, se forma una nueva clase de roca, llamada fulgurita (un tubo hueco que se forma cuando el rayo atraviesa la arena, la vaporiza y derrite el borde exterior. Cuando la arena se enfría, cosa que sucede enseguida, el tubo hueco se convierte en un vidrio que registra el recorrido del rayo. Por definición, una fulgurita es una roca metamórfica que, transformada por el calor y la presión, deja de ser arena y se convierte en algo nuevo.

Las fulguritas suelen escasear, a menos que se sepa dónde buscar. El centro de la zona peninsular de Florida alberga varias minas de arena que proporcionan materia prima para la fabricación de carreteras, cemento, campos de golf y pistas deportivas. En uno de esos yacimientos, hemos encontrado varios centenares de fulguritas; más de 250 se encontraban en el suelo, y muchas más en montones de escombros, filtradas de la arena antes de que esta fuese cargada en camiones.

Estos yacimientos no son, de hecho, distintos de cualquier otra zona de Florida —no son una especie de imán para los rayos—, pero el entorno geológico es el adecuado para que se conserven durante mucho tiempo. Estas minas de arena probablemente contengan fulguritas acumuladas desde hace un millón de años. Son fáciles de encontrar: como el vidrio no es algo deseable en la arena comercial, en la mina lo filtran y lo desechan.

El grosor de las fulguritas oscila entre, aproximadamente, el del dedo meñique de un bebé y el del brazo de un hombre adulto. Las más gruesas tuvieron que formarse por el impacto de rayos con mucha más energía: una fulgurita más gruesa equivale a una mayor cantidad de arena vaporizada. La mayoría de las fulguritas que hemos encontrado son fragmentos cortos, aunque las más largas medían uno o dos metros.

Cálculos basados en las fulguritas

Se necesita una cantidad específica de energía para vaporizar la arena. Primero, la arena debe calentarse hasta los 1.700 °C, aproximadamente la temperatura de la lava fundida. A esta temperatura, la arena se derrite. La arena derretida se tiene que calentar a continuación hasta unos 3.000 °C, punto en el que se vaporiza. Hacen falta unos 15 megajulios de energía para calentar y vaporizar un kilogramo de arena. Es aproximadamente la cantidad de energía que una familia estadounidense media consume en seis horas, o la energía cinética que tendría un coche medio si se moviese a 483 kilómetros por hora.

Tras medir nuestras fulguritas, llegamos a la conclusión de que la energía media necesaria para formar esas rocas fue de al menos un megajulio por metro de fulgurita formada. Calculamos la energía por metro porque, nuevamente en la mayoría de los casos, las fulguritas que recogimos estaban rotas.

Así que, según nuestros cálculos, ¿cuánto se acerca Hollywood con cálculos como los de Regreso al futuro, de 1,21 gigavatios de potencia en un rayo? La potencia es la energía en función del tiempo, y nuestras mediciones de las fulguritas indican que con megajulios de energía se forman rocas en milmillonésimas de segundo. De modo que un gigavatio se queda corto en realidad; la potencia de un rayo podría ser 1.000 veces superior, con lo que llegaría al teravatio, aunque el valor medio seguramente sea de decenas de gigavatios.

Con esa energía se proporcionaría electricidad a unos 1.000 millones de casas, aunque solo durante unas millonésimas de segundo. Por desgracia, dada su esporádica e impredecible naturaleza, ninguna red eléctrica podrá nunca aprovechar los rayos de forma eficaz. Pero con tantísima energía, puede que romper el continuo espacio-tiempo en un Delorean tuneado no sea tan inviable, después de todo...

Una singularidad en el patrón

Cuando estudiamos a fondo las fulguritas, los datos arrojaron un resultado extraño. Nuestras mediciones de energía seguían lo que se conoce como un patrón “logarítmico normal”.

En lugar de seguir la curva en forma de campana que suele tener la distribución de los fenómenos naturales —por ejemplo, la estatura de los hombres estadounidenses—, la curva de la energía presentaba un equilibrio más desigual. En el caso de la altura, hay el mismo número de hombres situados cinco centímetros por encima y cinco centímetros por debajo de la estatura media. Pero, en el caso de los rayos, los grandes eran mucho mayores que la media, mientras que los más pequeños no eran mucho más pequeños que la media. Los rayos que duplicaban la media eran tan frecuentes como los que se correspondían con la mitad de la media.

Ahora bien, ¿qué interés o utilidad podría tener este hallazgo? Medir la energía de los rayos es una forma de medir los daños que pueden causar: si un rayo es capaz de vaporizar una roca, ¿qué haría con la madera o los aparatos electrónicos? Nuestras mediciones ponen de manifiesto que los rayos más grandes son múltiplos de los rayos de magnitud media: uno grande puede ser 20 veces mayor que uno medio, lo cual es mucho para un

sistema de protección antirrayos. La energía máxima calculada mediante nuestro método de las fulguritas nos da una idea del daño máximo que podemos esperar y, en última instancia, nos permite estar mejor preparados para las peores situaciones posibles.

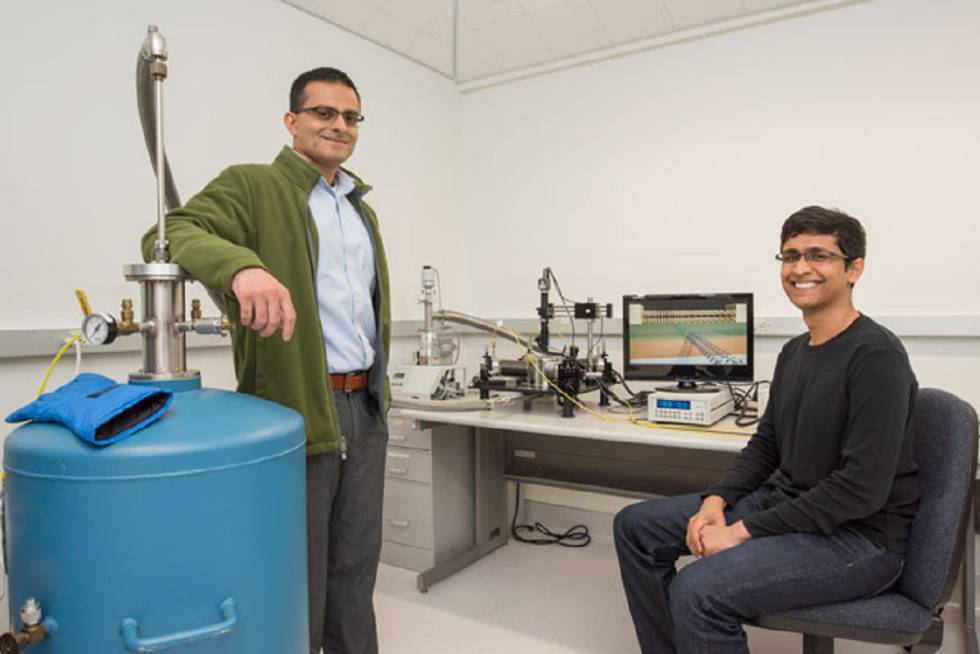

Matthew Pasek es Catedrático adjunto de Ciencias Geológicas (Universidad del Sur de Florida).

Un rayo cae sobre la playa de Alhucemas. ULY MARTÍN

Un rayo cae sobre la playa de Alhucemas. ULY MARTÍN